информационный критерий шварца чем меньше тем лучше

Информационный критерий

Информационный критерий — применяемая в эконометрике (статистике) мера относительного качества эконометрических (статистических) моделей, учитывающая степень «подгонки» модели под данные с корректировкой (штрафом) на используемое количество оцениваемых параметров. То есть критерии основаны на неком компромиссе между точностью и сложностью модели. Критерии различаются тем, как они обеспечивают этот баланс.

Информационные критерии используются исключительно для сравнения моделей между собой, без содержательной интерпретации значений этих критериев. Они не позволяют тестировать модели в смысле проверки статистических гипотез. Обычно чем меньше значения критериев, тем выше относительное качество модели.

Содержание

Информационный критерий Акаике (AIC)

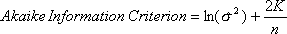

Предложен Хиротугу Акаике в 1971 году, описан и исследован им же в 1973, 1974, 1983 годах. Первоначально аббревиатура AIC, предложенная автором, расшифровывалась как «an information criterion» («некий информационный критерий»), однако последующие авторы называли его Akaike information criterion. Исходная расчетная формула критерия имеет вид:

где

Многие современные авторы, а также во многих эконометрических программных продуктах (например в EViews) применяется несколько иная формула, предполагающая деление на объем выборки

Данный подход позволяет сравнивать модели, оцененные по выборках разного объема.

Чем меньше значение критерия, тем лучше модель. Многие другие критерии являются модификациями AIC.

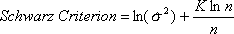

Байесовский информационный критерий (BIC) или критерий Шварца (SC)

Как видно из формулы, данный критерий налагает больший штраф на увеличение количества параметров по сравнению с AIC, так как

Прочие информационные критерии

Скорректированный критерий Акаике (Corrected AIC-

Критерий Ханнана-Куинна (Hannan-Quinn, HQ) предложен авторами в 1979 году

Данный критерий, наряду с AIC и BIC выдается в результатах оценки моделей с дискретными и ограниченными зависимыми переменными в EViews.

Имеются также модификации AIC, использующие более сложные штрафные функции, зависящие от фишеровской информации и других характеристик.

Информационные критерии в частных случаях

В частном случае классической нормальной линейной регрессии логарифмическая функция правдоподобия равна

где

Подставив значение логарифмической функции правдоподобия в формулу AIC (с делением на объем выборки), а также не учитывая постоянные слагаемые 1 и

Для систем эконометрических уравнений логарифмическая функция правдоподобия равна

Свойства

Применение разных критериев может привести к выбору разных моделей. Во многих работах эти критерии сравниваются, однако нет окончательного вывода о предпочтительности того или иного критерия. Поэтому программные продукты обычно приводят как минимум два критерия (AIC, BIC), для некоторых моделей также и третий (HQ). Известно, что для авторегрессионных моделей критерий AIC переоценивает порядок модели, то есть оценка порядка модели на основе этого критерия несостоятельна. Состоятельным критерием выбора порядка авторегрессионной модели является BIC.

Ссылки

Литература

Полезное

Смотреть что такое «Информационный критерий» в других словарях:

информационный критерий — Критерий, используемый при исследовании феномена НЛО по признаку необычной сложности, заключённой в нём информации, особенно среди палеофеноменов (например, памятников культуры далёкого прошлого). E. Information criterion D. Information Kriterium … Толковый уфологический словарь с эквивалентами на английском и немецком языках

Информационный критерий Акаике — (AIC) критерий, применяющийся исключительно для выбора из нескольких статистических моделей. Разработан в 1971 как «an information criterion» («(некий) информационный критерий») en:Hirotsugu Akaike и предложен им в статье 1974 года[1].… … Википедия

Критерий — признак, на основе которого производится оценка состояния ядерной и радиационной безопасности ядерных установок судов и иных плавсредств. Источник … Словарь-справочник терминов нормативно-технической документации

критерий безопасности информации — Показатель, характеризующий безопасность информации при воздействии различных факторов опасности. Критериями безопасности могут быть следующие показатели: для ПЭМИН абсолютный уровень ПЭМИН или соотношение информационный сигнал / помеха в эфире и … Справочник технического переводчика

критерий выдачи — Совокупность признаков, по которым определяется степень соответствия поискового образа документа поисковому предписанию и принимается решение о выдаче или невыдаче данного документа в ответ на информационный запрос. [ГОСТ 7.73 96 ] Тематики поиск … Справочник технического переводчика

Критерий выдачи — совокупность признаков, по которым: 1 определяется степень соответствия поискового образа документа поисковому предписанию; и 2 принимается решение о выдаче или невыдаче того или иного документа в ответ на информационный запрос. По английски:… … Финансовый словарь

Критерий выдачи — 47. Критерий выдачи Ндп. Критерий смыслового соответствия D. Kriterien der Ausgabe E. Relevancy criterion F. Critere de pertinence Заданные формальные правила, по которым принимается решение о выдаче документа или факта по запросу… … Словарь-справочник терминов нормативно-технической документации

Критерий соответствия — совокупность правил, по которым при информационном поиске (См. Информационный поиск) определяется степень соответствия поискового образа документа поисковому предписанию и принимается решение о выдаче или невыдаче этого документа в ответ… … Большая советская энциклопедия

критерий выдачи — Rus: критерий выдачи Eng: retrieval criterion Совокупность признаков, по которым определяется степень соответствия поискового образа документа поисковому предписанию и принимается решение о выдаче или невыдаче данного документа в ответ на… … Словарь по информации, библиотечному и издательскому делу

Модель бинарного выбора — Модель бинарного выбора применяемая в эконометрике модель зависимости бинарной переменной (принимающей всего два значения 0 и 1) от совокупности факторов. Построение обычной линейной регрессии для таких переменных теоретически… … Википедия

Выбор наилучшей линейной модели: критерий Акаике и Шварца

Приведем пример использования информационных критериев при выборе наилучшей спецификации линейной модели.

Рассматривалась задача оценки влияния различных индексов цен на среднедушевое потребление бензина в США. (Исходные данные взяты из книги Green W., «Econometric Analysis», 3th edition, International Edition, pp.327).

Файл в системе STATISTICA выглядит следующим образом:

YEAR – время,

G – среднедушевое потребление бензина (общие расходы на бензин, деленные на индекс цен),

Pg – индекс цен на бензин,

Y – чистый среднедушевой доход населения,

Pnc – индекс цен на новые автомобили,

Puc – индекс цен на подержанные автомобили,

Ppt – индекс цен на услуги общественного транспорта,

Pd – индекс цен на товары долговременного пользования,

Pn – индекс цен на скоропортящиеся товары,

Ps – индекс цен на услуги.

Будем рассматривать различные спецификации линейных моделей. В качестве зависимой переменной выберем среднедушевое потребление бензина. На первом этапе в качестве регрессоров будем использовать все остальные переменные. Результаты регрессии в этом случае:

Воспользуемся теперь процедурой пошагового исключения статистически незначимых регрессоров из модели, доступной в модуле STATISTICA «Множественная регрессия». Процедура последовательно исключает регрессоры, у которых значения t-статистик оценок коэффициентов ниже критического уровня.

Окончательная спецификация в этом случае включает кроме свободного члена три регрессора: YEAR, Pg, Ps. Результаты оценки модели:

Наконец, применим метод пошагового включения статистически значимых переменных в модель. Процедура последовательно включает регрессоры в модель, если значения t-статистик оценок коэффициентов получаются выше критического уровня.

В этом случае в модель вошли все переменные, кроме Pnc – индекса цен на новые автомобили. Результаты оценки модели:

Возникает вопрос: какая из рассмотренных спецификаций предпочтительнее? Ответим на этот вопрос, используя сравнение моделей по критериям Akaike и Schwartz. Для расчета критериев была написана программа на STATISTICA Visual Basic.

Для спецификации, включающей все регрессоры, число ограничений на степени свободы равно десяти, сумма квадратов ошибок 448.831. Значение критериев:

AIC = ln(448.831/27) + 2*10/27 = 3.551.

Schwartz = ln(448.831/27) + 10*ln(27)/27 = 4.031.

Для спецификации, в которой в модели присутствуют лишь статистически значимые регрессоры (YEAR, Pg, Ps) число ограничений на степени свободы равно четырем, сумма квадратов ошибок 939.361. Значения критериев:

AIC = ln(939.361/27) + 2*4/27 = 3.845.

Schwartz = ln(939.361/27) + 4*ln(27)/27 = 4.037.

Спецификация, полученная в результате процедуры пошагового включения (вошли все регрессоры, кроме Pnc – индекса цен на новые автомобили, число ограничений на степени свободы равно девяти, сумма квадратов остатков 470.52. Значения критериев:

AIC = ln(470.52/27) + 2*9/27 = 3.524.

Schwartz = ln(470.52/27) + 9*ln(27)/27 = 3.956.

Спецификация, включающая все регрессоры, кроме индекса цен на новые автомобили, показывает меньшие значения критериев. Следовательно, делаем вывод о том, что данная спецификация предпочтительнее остальных.

Рассмотрим другой пример: подгонка функции полиномами различных степеней. В качестве исходных данных взят временной ряд длиной 20 наблюдений. Будем подгонять этот ряд линейными регрессиями, в которых регрессоры будут являться полиномами различных степеней – Х, Х2. Х7.

Наша задача – выбрать оптимальную степень наибольшего полинома. Будем сравнивать модели с различными степенями полиномов по критериям Akaike и Schwartz. Модель, показывающую наименьшие значения критериев, будем считать оптимальной.

График наблюдаемых и предсказанных значений

График наблюдаемых и предсказанных значений

Результаты для регрессии Y = a0 + a1X + а2Х 2 + а3Х 3 + e:

График наблюдаемых и предсказанных значений

График наблюдаемых и предсказанных значений

График наблюдаемых и предсказанных значений

График наблюдаемых и предсказанных значений

График наблюдаемых и предсказанных значений

График наблюдаемых и предсказанных значений

Сравнительный график предсказаний для моделей со степенями полиномов n=7 и n=8

Результаты показывают, что минимум значений критериев Akaike и Schwartz наблюдается при самой высокой степени полинома, равной семи. Следовательно, делаем вывод о том, что при подгонке исследуемого ряда целесообразно использовать спецификацию с наивысшей степенью полинома, равной семи.

Дополнительным доводом в пользу такого выбора спецификации может служить значение скорректированного R2, которое является наибольшим из всех рассматриваемых.

Графический анализ качества подгонки полиномами неизвестной функции дает следующий результат: при повышении степени полинома с n=1 до n=7 улучшение объясняющих свойств модели можно наблюдать визуально.

На изображенных графиках предсказанные значения приближаются к реальным данным с увеличением степени полинома. При использовании полинома восьмой степени качество подгонки практически не улучшается.

На приведенном сравнительном графике предсказаний для моделей со степенями полинома n=7 и n=8 графики предсказанных значений сливаются, следовательно, использование полинома восьмой степени избыточно и практически не улучшает прогнозных свойств модели.

Этот вывод и подтверждается ростом значения критерия Akaike.

Информационные критерии (критерий Акайке, Шварца)

Определение 4.1. Спецификация подели – оптимальность ее выбора, т.е. соответствие исходным данным.

Анализ правильности спецификации играет важную роль в экономических исследованиях и прогнозах.

Под спецификацией модели следует также понимать правильный выбор набора объясняющих переменных (независимых факторов).

В случае, когда в модель не включена существенная переменная, могут быть следующие последствия:

1) Исчезают возможности, верно, оценить и интерпретировать уравнение.

2) Коэффициенты при оставшихся переменных становятся смещенными.

3) Стандартные ошибки коэффициентов и t-статистики некорректны, следовательно, не могут быть использованы для суждения о качестве подгонки предлагаемой модели.

В случае если включена линейная переменная, то это обстоятельство ведет к увеличению стандартных ошибок и, как следствие, к статистической незначимости оценок.

Существуют информационные критерии, позволяющие выбирать из множества моделей наилучшую, т.е. производить спецификацию.

Наиболее часто применяют критерии Акайке, Шварца.

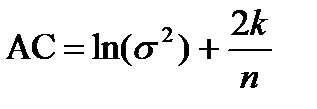

Критерий Акайке рассчитывается по формуле:

k- число ограничений на стационарность

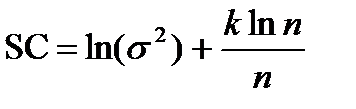

Критерий Шварца:

При сравнении множества моделей по информационным критериям выбираются модели, для которых значения AC и SC – минимальны.

Примечание: Особенно часто информационные критерии используются для полиномиальной регрессии, чтобы определить стационарность полинома.

При построении модели, адекватно описывающей изучаемый процесс в экономике, очень важную роль играет анализ правильности ее спецификации. Отрицательно на объясняющих свойствах модели сказывается как отсутствие значимой переменной, так и избыточное присутствие незначимой.

В случае, когда в модель не включена существенная переменная (существенной называют переменную, которая должна быть в модели согласно правильной теории), наблюдаются следующие последствия:

1.Исчезает возможность правильной оценки и интерпретации уравнений.

2.Коэффициенты при оставшихся переменных становятся смещенными.

3.Стандартные ошибки коэффициентов и t-статистики некорректны и не могут быть использованы для суждения о качестве подгонки предлагаемой модели.

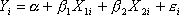

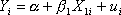

Например, предположим, что из модели

Если объясняющие переменные Х1 и Х2 коррелированы, то нарушается предпосылка теоремы Гаусса-Маркова о некоррелированности случайного члена и регрессоров, поскольку в этом случае между Х1 и u существует ненулевая корреляция. Оценки, полученные по методу наименьших квадратов для данной модели, уже не являются эффективными среди линейных оценок.

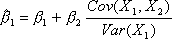

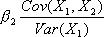

Оценки даже не являются несмещенными, поскольку для МНК оценки коэффициента β1 в этом случае получаем:

Включение несущественной переменной в модель не приводит к смещению оценок коэффициентов, но появляется другой недостаток – растут стандартные ошибки коэффициентов. Оценки становятся статистически незначимыми.

Если точная спецификация модели неизвестна (что практически всегда и бывает), то пользуются критериями, позволяющими выбирать из некоторого множества моделей наилучшую.

Наиболее распространенными критериями является критерий Шварца (Schwarz) и критерий Акайке (Akaike). Оба критерия позволяют выбирать наилучшую модель из множества различных спецификаций. Критерии численно построены так, чтобы учесть влияние на качество подгонки модели двух противоположных тенденций.

При добавлении переменных в модель качество подгонки в общем случае увеличивается. Заметим, что число регрессоров должно быть разумным, чтобы не вызвать «искусственной подгонки» зависимой переменной объясняющими. С другой стороны, недостаточное включение переменных в модель дает большую стандартную ошибку, и качество подгонки снижается.

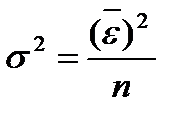

Формулы для расчета критериев Akaike и Schwarz:

где

Первое слагаемое представляет собой штраф за большую дисперсию, второе – штраф за использование дополнительных переменных. Критерии рассчитываются для каждой рассматриваемой спецификации. При сравнении двух типов моделей предпочтение отдается спецификации, которая имеет наименьшие значения критериев.

Информационный критерий

Информационный критерий — применяемая в эконометрике (статистике) мера относительного качества эконометрических (статистических) моделей, учитывающая степень «подгонки» модели под данные с корректировкой (штрафом) на используемое количество оцениваемых параметров. То есть критерии основаны на неком компромиссе между точностью и сложностью модели. Критерии различаются тем, как они обеспечивают этот баланс.

Информационные критерии используются исключительно для сравнения моделей между собой, без содержательной интерпретации значений этих критериев. Они не позволяют тестировать модели в смысле проверки статистических гипотез. Обычно чем меньше значения критериев, тем выше относительное качество модели.

Содержание

Информационный критерий Акаике (AIC) [ править | править код ]

Предложен Хиротугу Акаике в 1971 году, описан и исследован им же в 1973, 1974, 1983 годах. Первоначально аббревиатура AIC, предложенная автором, расшифровывалась как «an information criterion» («некий информационный критерий»), однако последующие авторы называли его Akaike information criterion. Исходная расчетная формула критерия имеет вид:

Данный подход позволяет сравнивать модели, оцененные по выборках разного объема.

Чем меньше значение критерия, тем лучше модель. Многие другие критерии являются модификациями AIC.

Байесовский информационный критерий (BIC) или критерий Шварца (SC) [ править | править код ]

Байесовский информационный критерий (Bayesian information criterion — BIC) предложен Шварцем в 1978 году, поэтому часто он называется также критерием Шварца (Schwarz criterion — SC). Он разработан исходя из байесовского подхода и является наиболее часто используемой модификацией AIC:

Прочие информационные критерии [ править | править код ]

Состоятельный критерий Акаике (Consistent AIC — CAIC) предложенный в 1987 году Боздоганом:

Скорректированный критерий Акаике (Corrected AIC- A I C c <\displaystyle AIC_

A I C c = A I C + 2 k ( k + 1 ) n − k − 1 <\displaystyle AIC_

Критерий Ханнана-Куинна (Hannan-Quinn, HQ) предложен авторами в 1979 году

Данный критерий, наряду с AIC и BIC выдается в результатах оценки моделей с дискретными и ограниченными зависимыми переменными в EViews.

Имеются также модификации AIC, использующие более сложные штрафные функции, зависящие от фишеровской информации и других характеристик.

Информационные критерии в частных случаях [ править | править код ]

В частном случае классической нормальной линейной регрессии логарифмическая функция правдоподобия равна

l = − n / 2 ( 1 + ln 2 π + ln σ ^ 2 ) <\displaystyle l=-n/2(1+\ln 2\pi +\ln <\hat <\sigma >>^<2>)>

A I C = 2 k / n + ln σ ^ 2 <\displaystyle AIC=2k/n+\ln <\hat <\sigma >>^<2>>

Свойства [ править | править код ]

Применение разных критериев может привести к выбору разных моделей. Во многих работах эти критерии сравниваются, однако нет окончательного вывода о предпочтительности того или иного критерия. Поэтому программные продукты обычно приводят как минимум два критерия (AIC, BIC), для некоторых моделей также и третий (HQ). Известно, что для авторегрессионных моделей критерий AIC переоценивает порядок модели, то есть оценка порядка модели на основе этого критерия несостоятельна. Состоятельным критерием выбора порядка авторегрессионной модели является BIC.