Технология дипфейк что это

Дипфейки: кому и зачем они нужны

Дипфейк (deepfake) – производная от «глубокого обучения» и «подделки»; штука, про которую сегодня большинство говорит с опаской. Само название как бы кричит: «Я зло!». А наша гипотеза в том, что это технология с огромнейшим позитивным потенциалом, которая пока используется в основном как игрушка в руках неразумного человека. Что это и как на самом деле? Давайте разбираться.

Дипфейки используют технологии искусственного интеллекта для синтеза изображений, в результате чего один персонаж как бы накладывается на другого и получается «комбо»: оживает Мона Лиза или Терминатором становится Бред Питт.

Эта технология позволяет легко манипулировать аудио- и видеоконтентом, а по мере того, как она развивается, разобраться, где правда, а где фейк – становится всё сложнее. Так в прогремевшем на весь интернет видео Барак Обама критикует Дональда Трампа, называя его «полным провалом». В США считается, что дипфейки представляют угрозу национальной безопасности. В Калифорнии некоторые виды дипфейков даже запретили законодательно.

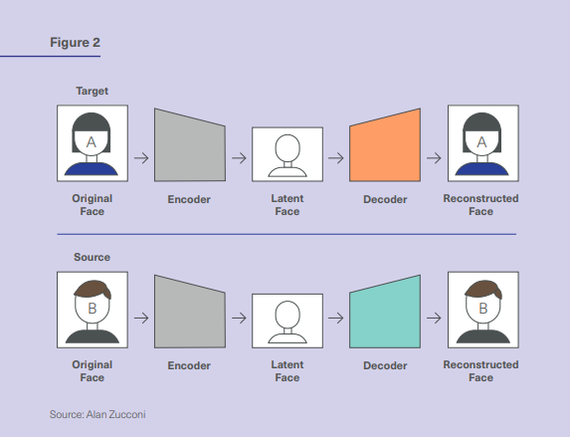

Чаще всего дипфейки создаются с помощью генеративно-состязательной сети (GAN), в ней 2 системы: генератор и дискриминатор. Они работают как пара студентов в университетской микрогруппе: один предлагает идеи, другой их критикует. Генератор создаёт изображения, а обученный на реальных фотографиях дискриминатор подсказывает, что нужно исправить.

Заметим, что технология постоянно развивается. Так, например, алгоритм BigGAN от Google и NVIDIA позволяет не просто воссоздавать, а создавать лица несуществующих людей, которые невозможно отличить от настоящих.

Недавно разработчики из Samsung и Сколково представили алгоритм на основе BigGAN, который позволил «оживить» Мону Лизу, то есть для (относительно) хорошего результата нейросети достаточно одного кадра. Нейросеть работает лучше всего, если дать ей несколько изображений человека, снятых под разными углами.

Сейчас на рынке десятки приложений, с помощью которых любой может сделать дипфейк, самые известные – Zao, DeepFaceLab, Deepfakes web β.

Конкурентные преимущества приложений похожи на классический треугольник «цена-качество-скорость»:

– Скорость. Одни выполняют конверсию за секунды, другим нужны часы.

– Необходимое количество исходного материала. Некоторым достаточно одной фотографии.

– Точность итогового результата. Обычно чем больше исходного материала и дольше идёт процесс анализа, тем точнее получается результат.

Год назад NVIDIA представила нейросеть, которая может превращать скетчи в реальные изображения. Технологию назвали GauGAN в честь Поля Гогена. Такую штуку можно использовать в архитектуре, дизайне, создании игр, да где угодно.

Технологию, которая лежит в основе дипфейков, можно использовать и в киноиндустрии, рекламе или при реконструкции исторических событий. Например, с её помощью была сделана социальная реклама, в которой Дэвит Бэкхем рассказывает об опасности малярии на 9и языках.

Музей Сальвадора Дали во Флориде «оживил» художника с помощью всё той же технологии. В результате зрители могли пообщаться с Дали, послушать его истории и даже получить совместное селфи. Для этого потребовалось 6000 фотографий Дали, 1000 часов машинного обучения и 145 видео с актером похожих пропорций, а ещё горы интервью и писем художника, чтобы воспроизвести голос, акцент и манеру речи.

Кстати, алгоритм GAN предлагается использовать и в астрофизике для того, чтобы избавляться от помех и шумов при съёмке космических объектов и получать качественные изображения.

Если вы тоже считаете, что человеческий интеллект создан для творчества, а машинный – для работы, присоединяйтесь к нам на YouTube или в Facebook!

Как делают дипфейки

Вы не могли не видеть роликов, где известным киноперсонажам подставляют лица других актеров. Иногда подобные замены выглядят удивительно достоверно. Сегодня рассказываю про дипфейки.

Таким образом дипфейки используют технологии искусственного интеллекта для синтеза изображений. На сегодняшний день существуют разные архитектуры алгоритмов, которые переносят лица с видео на видео.

Уши, лоб и волосы остаются в целевом видео родными, поскольку алгоритмы пересаживают исключительно область от бровей до подбородка и от уха до уха. В связи с этим нужно находить похожих друг на друга людей или использовать грим, как в случае с коммерческими проектами. На конечный результат цвет кожи и волос, а также комплекция и форма лица. Тот же Хавьер Бардем качественнее поженился со Шваренеггером чем с Ди Каприо или Уиллемом Дэфо, поскольку у них в жизни формы черепа похожи. Также нужно учитывать положение головы и крупность в донорском и целевом видео. Несовпадения принесут плачевные результаты. Оба человека должны побывать в максимально совпадающих условиях и ситуациях. На постпродакшен этапе при помощи композа и масок, конечно, можно докрутить и отшлифовать, но сама по себе технология еще требует серьезной доработки, чтобы выдерживать кинематографическое качество и впоследствии стать мощным инструментом, который бы не накладывал столько ограничений, а наоборот давал гибкость. В менее требовательном, но на более оборотистом рынке рекламы нейросети уже востребованы. А уж сколько однокнопочных сервисов для мобилок появилось. Но важно помнить, что качественный результат всегда требует времени. Тот же проект с Сальвадором Дали потребовал 1000 часов машинного обучения, 6000 фотографий и 146 видео с похожим внешне актером.

Рекламу для Сбера тоже делали ни один месяц. Наконец, для документального фильма «Добро пожаловать в Чечню» также использовали замену лиц, чтобы скрыть личности респондентов. Но там это и не скрывается. Фейк виден невооруженным глазом. Тем не менее это большой и серьезный труд по работе с дублерами и нейросетями, чтобы передать эмоции пострадавших представителей меньшинств.

Можете самостоятельно натренировать нейросеть. Ниже ссылки:

Искусственный интеллект

425 постов 5.1K подписчиков

Правила сообщества

Здесь вы можете свободно создавать посты по теме Искусственного интеллекта. Добро пожаловать 🙂

— Делиться вопросами, мыслями, гипотезами, юмором на эту тему.

— Делиться статьями, понятными большинству аудитории Пикабу.

— Делиться опытом создания моделей машинного обучения.

— Рассказывать, как работает та или иная фиговина в анализе данных.

— Век жить, век учиться.

I) Невостребованный контент

I.1) Создавать контент, сложный для понимания. Такие посты уйдут в минуса лишь потому, что большинству неинтересно пробрасывать градиенты в каждом тензоре реккурентной сетки с AdaGrad оптимизатором.

I.2) Создавать контент на «олбанском языке» / нарочно игнорируя правила РЯ даже в шутку. Это ведет к нечитаемости контента.

II) Нетематический контент

II.1) Создавать контент, несвязанный с Data Science, математикой, программированием.

II.2) Создавать контент, входящий в противоречие существующей базе теорем математики. Например, «Земля плоская» или «Любое действительное число представимо в виде дроби двух целых».

II.3) Создавать контент, входящий в противоречие с правилами Пикабу.

III) Непотребный контент

Умиляет личность, рекламирующая сбер. Вот, если я не ошибаюсь.Очень символично. Сейчас ролик с тв убрали.

Термин дипфейк происходит от слов «deep learning»,

@moderator в машинное обучение

Хорошо, хоть не дикпики!

Чего сказать то хотел? Всё, что ты тут изложил, уже миллион раз обсосано и высрано. Даже здесь, на пикабе.

Стимпанк цилиндр

Всем привет, вот и я наконец нашел повод для написания первого поста! Моя первая законченная и выложенная на arstation работа. Буду рад критике и комментариям

Первая осознанная работа в Corona

Нейронные сети учатся распознавать Deepfake

Пару недель назад я выложил пост про нейронные сети, которые способны удалять с видео любые движущиеся объекты и всякие следы их существования. Тени от этих объектов, поднятую пыль, иногда даже почти хорошо удалялись волны на воде. И тогда, под тем постом, прямо таки развернулась дискуссия о том, как в принципе можно было бы бороться с подделкой видео. Не только с удалением объектов, но и с теми же дипфейками.

Этим вопросом и задались учёные из Германии и Италии. Ниже прикладываю презентацию их совместной научной работы.

А также, как и в прошлый раз, прикладываю своё собственное видео, с разбором того, а чём именно идёт речь в их презентации.

Итак, краткая выжимка того, о чём именно их работа. Конкретно эта группа учёных не ставила перед собой задачу разработать концептуально новую нейронную сеть, которая бы хорошо распознавала подделку на видео. Они провели комплексную сравнительную работу. Взяли набор видео, часть из которых была отредактированная нейронными сетями, а часть нет. И, с одной стороны, попросили группу людей угадать, какие именно видео являются подделками, а с другой стороны точно такую же задачу поставили перед распространёнными свёрточными нейронными сетями, основная задача которых как раз заключается в распознавании на видео и фотографиях тех или иных объектов. То есть, они брали не специализированные нейросети, а самые обычные. Те, которыми можно распознавать на видео котиков, к примеру.

По сути, самая очевидная идея в данном случае оказывается самой эффективной. Зачем придумывать сложные схемы борьбы с нейросетями, если можно просто заставить бороться с ними другие нейросети. Безусловно, данный метод не является самым надёжным. Но уже сегодня он является наиболее оправданным с позиции точности распознавания и ресурсов, которые требуются на создание такой системы. По факту, использовав созданный учёными в данной работе массив видео для обучения нейросетей, вы сможете у себя дома создать свою собственную систему распознавания дипфейков. Единственным ограничением правда будет время обучения такой сети. Если не использовать видеокарты NVidia старше 20хх серии и разработанную ими же библиотеку для машинного обучения, создание такой сети может затянуться на месяцы. Но тем не менее, такая возможность у вас всё ещё остаётся.

Дипфейки: что это такое, зачем и кому они нужны + 13 кейсов

Том Круз решил «побаловать себя»: ест чупа-чупс, находит в нем жвачку и удивляется. Все это, естественно, практически в прямом эфире. Звезды все ближе к обычным людям! Или нет? Нет, это всего лишь deepfake-версия Тома Круза, но сходство впечатляющее, правда?

В этой статье рассказываем о том, что такое дипфейки, как их создают, чем они опасны, а также делимся кейсами их использования не только в формате шуточных видео, но и в «серьезном» маркетинге.

Что такое дипфейки

В начале 2021 года TikTok-видео с участием Тома Круза и правда набрали популярность. Поражают и внешнее сходство дипфейка с актером, и то, как точно передан его знаменитый смех. Этого «Тома Круза» создал Крис Уме, бельгийский специалист по deepfake-эффектам.

Deepfake (deep learning, «глубокое обучение» + fake «фейк, подделка) — методика синтеза изображения, основанная на искусственном интеллекте. Она используется для соединения и наложения существующих изображений и видео на исходные изображения или видеоролики.

В создании дипфейков участвуют GAN — генеративно-состязательные сети. Генеративная часть алгоритма, обучаясь на существующих фото, создает изображение. А состязательная — буквально «соревнуется» с первой частью алгоритма, стараясь отличить настоящие изображения от ненастоящих. В процессе этого соревнования и создаются дипфейки — изображения и видео, которые действительно трудно отличить от реальных, созданных человеком.

Даниил Охлопков, Data Lead в Runa Capital: «Сгенерированные изображения и видео со временем станут реалистичнее. Будет меньше видимых артефактов — следов того, что изображение было сгенерировано нейронной сетью.

Обратите внимание, на первой картинке слева появился перевернутый рот, на второй смазаны зубы. Аналогичные неточности (артефакты) можно находить и на видео с дипфейками.

Сейчас для создания фотореалистичного deepfake необходима постобработка. Это наглядно показали создатели видео, где актер Том Круз баллотируется в президенты США.»

На мой взгляд, технологию ожидает бумообразный рост в ближайшие несколько лет. Нынешний уровень развития технологии и ее перспективы стимулируют интерес, а значит, все больше разработчиков будут применять и использовать ее для решения своих задач. Решения будут все доступнее, дешевле и при этом качественнее.

На развитие будет сильно влиять то, как эта технология воспримется законодательно.

С одной стороны, все понимают, что мировую эволюцию deepfake не сдержать силами государства в отдельных странах.

С другой, это одна из наиболее опасных технологий в рамках текущей парадигмы безопасности, которая поддерживает мнение о том, что биометрия — отличный способ идентифицировать человека.

Григорий Иванов, основатель группы компаний Neutronix

Опасность технологии

У дипфейков практически безграничные возможности: с их помощью можно «заставить» кого угодно говорить и делать что угодно. В 2018 году режиссер Джордан Пил создал видео, на котором Барак Обама говорит об опасности дипфейков и fake news (фальшивые новости) в целом:

«It may sound basic, but how we move forward in the age of information is going to be the difference between whether we survive or whether we become some kind of fucked-up dystopia».

«Это прозвучит банально, но пока мы на пути к веку информации, главный вопрос для нас — сможем ли мы выжить, или мир превратится в какую-то извращенную антиутопию».

На видео Обама ругает Трампа, не стесняясь выражений, и очень легко поверить в то, что это действительно бывший президент США. Видео было создано, чтобы предупредить пользователей об опасности дипфейков, а также призвать их не верить всему, что они видят.

Кроме того, дипфейки могут «помочь» развитию мошенничества в интернете или даже по телефону. В 2019 году CEO британской энергетической компании заплатил мошенникам 220 тыс. евро, потому что думал, что об этом попросил его босс, голос которого в телефонном разговоре сгенерировали киберпреступники.

В связи с этими проблемами появились программы и гранты для тех, кто создаст лучший детектор дипфейков.

Facebook активно занимается изучением дипфейков и способов им противостоять. В созданном компанией Deepfake Detection Challenge поучаствовали более 2 тыс. специалистов. Благодаря этому челленджу у AI-исследователей появятся новые методы для распознавания дипфейков, которые несут угрозу обществу.

В России на похожее исследование было выделено почти 5 млн р.

Будет война генераторов реалистичных дипфейков и их детекторов. Уже сейчас Facebook инвестирует в это направление, а на сайте по анализу данных Kaggle проходят соревнования на лучший детектор дипфейков. Twitter недавно добавил возможность помечать контент как фейк, включая видео с дипфейками. Решением может стать обязательное использование водяных знаков.

Даниил Охлопков, Data Lead в Runa Capital

«Хорошие» кейсы

Дипфейки сами по себе не опасны. Есть и хорошие кейсы использования deepfake-технологий.

Например, дипфейки могут помогать людям. У Microsoft есть приложение Seeing.AI для слепых и слабовидящих людей: cинтезированный голос комментирует все, что происходит вокруг человека с нарушениями зрения, помогая ему ориентироваться в мире

Дипфейки можно применять в образовании. WPP — британский международный холдинг в области коммуникаций, рекламы, связей с общественностью, технологий и торговли. Во время пандемии COVID-19 этой компании понадобилась программа для корпоративного обучения. Это было как раз в разгар локдауна, поэтому сделать видео с реальными спикерами было невозможно.

WPP обратилась к Synthesia, компании, специализирующейся на AI, и те создали для них обучающую программу, где в качестве лекторов выступают deepfake-аватары.

Дипфейки используются и в искусстве. Специалисты из Сколково и Samsung «оживили» Мону Лизу:

Кстати, при создании «Форсаж-7» тоже использовались deepfake-технологии. Получается, в теории они могут помочь решить проблему с дублерами и удешевить производство видеоконтента.

Представьте, как много рекламного и промо-контента можно генерировать даже без участия реальных знаменитостей. Может, в будущем они будут просто продавать свои образы, а студии получат возможность делать невероятный, но очень реалистичный контент. Меньше времени на съемку, возможность участвовать сразу в нескольких проектах одновременно вообще не выходя из дома. Все это — потенциально огромные рекламные контракты.

Юлия Плосконосова, аккаунт-директор Mailfit

Применение в маркетинге и рекламе

Можно ли применять deepfake-технологии в рекламе? Да! Ниже — несколько успешных кейсов, которые могут послужить референсами для ваших рекламных кампаний.

Vivienne Sabo

Бренд косметики — один из российских пионеров применения deepfake-технологий. В 2020 году компания запустила рекламный видеопроект с использованием технологии замены лиц.

На сцене кабаре мог оказаться каждый. Достаточно было загрузить свое фото на специальном лендинге или в приложении на базе Vk Mini Apps и получить видео. Кампания уже завершена, так что сделать видео больше нельзя.

Технология дополненной реальности позволяет покупателю примерить одежду, обувь, бижутерию, попробовать макияж виртуально. Deepfake-технология способна сделать то же самое. В отличие от AR, она показывает не просто то, подходит ли вещь, а как сам человек выглядит с ней со стороны.

Алексей Рыбаков, генеральный директор IT-компании Omega

Clarins

Этот бренд косметики тоже предлагает примерить макияж не выходя из дома. Нужно всего лишь перейти на страницу средства в интернет-магазине и нажать кнопку «Макияж онлайн». Можно загрузить фото из галереи телефона или снять новое. Примерять можно средства для лица, глаз и губ.

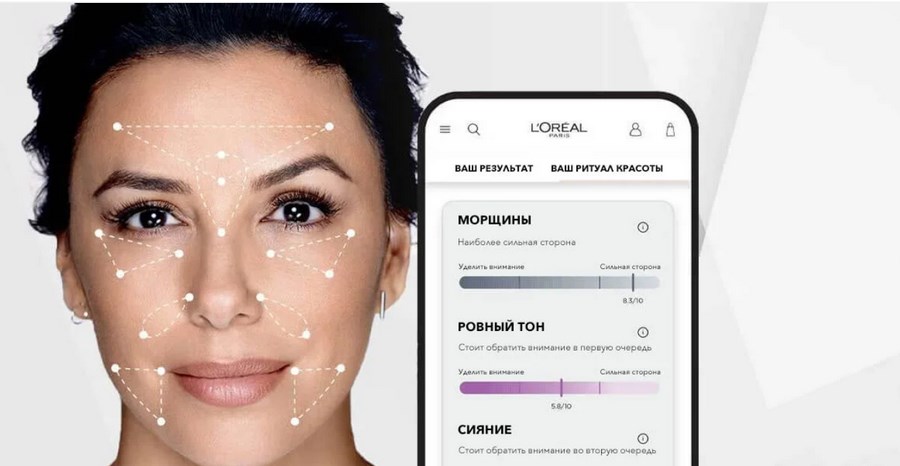

Похожие инициативы есть у Maybelline New York, NYX, Armani, Mary Kay, L’Oreal Paris (там даже можно «примерить» цвет волос и определиться с краской) — в общем, у многих марок косметики.

L’Oreal Paris

Кстати, о L’Oreal. У компании есть не только примерка макияжа онлайн. Skin Genius от L’Oreal — это digital-инструмент, который анализирует качество кожи в реальном времени с помощью AI. Программа сравнивает кожу с 10 000 реальных снимков от экспертов-дерматологов и на основе анализа рекомендует активные ингредиенты и конкретные советы и продукты по уходу за кожей.

С помощью deepfake-технологий «Сбер» «вернул к жизни» Жоржа Милославского, героя фильма «Иван Васильевич меняет профессию».

Герой предновогодней рекламы оказался в 2020 году, прокатился на «Ситимобиле», воспользовался приложением «Сбер.Онлайн», послушал музыку в «Сбер.Звуке», оплатил покупки телефоном, получил доставку из «Сбер.Маркета» и попал на концерт NILETTO.

Для воссоздания голоса героя была использована технология text-to-speech и реальные записи речи актера (Леонида Куравлева) общей длиной около 4-х минут. Несмотря на то, что это очень мало, специалистам «Группы ЦРТ» удалось синтезировать голос Милославского.

ESPN & Netflix

ESPN, американский кабельный канал, запустил рекламу документального сериала о Майкле Джордане («The Last Dance»). В рекламе спортивный ведущий Кенни Мэйн в 1998 году делает предсказания о том, что в 2020 ESPN снимет шоу о звезде баскетбола, а еще что «джинсы будут очень узкими», в целом делая отсылки к тому, каким будет будущее. Конечно, это не настоящий Кенни Мэйн, а его deepfake-версия.

Дипфейки удешевляют производство рекламы и любого видеоконтента. Недавно HBO сняла рекламу своего спортивного канала, в котором должны были принять участие звезды NBA. Из-за карантина путешествия и личные встречи со спортсменами были ограничены, поэтому создатели ролика сняли актеров с похожей внешностью, а потом с помощью технологии наложили лица реальных спортсменов.

Чтобы сделать видео, присутствие знаменитости на съемочной площадке вовсе не обязательно, а значит и гонорар звезды может быть значительно меньше.

Даниил Охлопков, Data Lead в Runa Capital

Malaria No More

Если компания работает на несколько рынков, снимать каждый раз новый ролик для каждого языка нет необходимости. Алгоритмы могут настроить движения лица модели и речь под необходимую языковую аудиторию.

Алексей Рыбаков, генеральный директор IT-компании Omega

Deepfake-технологии могут помочь брендам привлечь клиентов с помощью целенаправленных и персонализированных сообщений. Инфлюенсерам и селебрити дипфейки помогут больше и лучше взаимодействовать с аудиторией. Например, знаменитость может выступить в рамках модной рекламной кампании, даже не приходя на фотосессию.

Deepfake помогает повысить вовлечннность. К примеру, в 2020 году приложение Reface AI позволило пользователям виртуально примерить одежду Gucci.

В ретейле есть перспективы персонализировать обслуживание клиентов, используя deepfake-помощника, который обрабатывает онлайн-запросы, разговаривая с клиентом на одном языке. Так покупатели могут разговаривать с «настоящим» лицом, что повышает доверие к сервису.

Виталий Миняйло, сооснователь и СЕО IT-компании neurotrack.tech

Онлайн-примерочная

Русскоязычный разработчик Алексей Чаплыгин создал технологию, которая позволяет виртуально изменять параметры тела. Автор разрабатывал технологию для виртуальных примерочных, чтобы люди при просмотре одежды в интернет-магазине могли видеть вещи на себе, а не на моделях.

Бизнесу можно и нужно использовать дипфейки, если соблюдены два условия: на это есть колоссальные бюджеты, и остальные способы персонализации взаимодействия с аудиторией уже испробованы.

Сегодня deepfake — все еще дорогая технология, доступная далеко не каждой компании. Компаниям со скромными бюджетами предлагаем вместо одного взрывного ролика разработать грамотную стратегию продвиженияи вложиться в постоянный стабильный рост.

Раньше обращение телевизионной картинки прямо к конкретному зрителю было лишь сюжетом фантастических фильмов. Но теперь один и тот же рекламный ролик может быть настроен, например, под имя конкретного пользователя или сегмент целевой аудитории, которые не смогут понять, что движениями губ управляют алгоритмы, а не человек.

Алексей Рыбаков, генеральный директор IT-компании Omega

Скорее всего, технология станет привычным инструментом типа Photoshop. Ее можно будет использовать как в хороших целях — удешевление стоимости видеопродакшена с дорогими актерами, так и в сомнительных — для создания фейковых видео с известными личностями.

Даниил Охлопков, Data Lead в Runa Capital

Что думаете о развитии дипфейков? Видите в них качественный рекламный инструмент или пока не готовы использовать в работе?