закон энтропии что это

Вездесущая энтропия: от смерти Вселенной до груды грязной посуды

Михаил Петров

«Все процессы в мире происходят с увеличением энтропии» — эта расхожая формулировка превратила энтропию из научного термина в непреложное свидетельство обреченной борьбы человека с окружающим его беспорядком. Но что в оригинале скрывается за этой физической величиной? И как можно посчитать энтропию? «Теории и практики» попытались разобраться в этом вопросе и найти спасение от надвигающегося распада.

Термодинамика и «тепловая смерть»

Впервые термин «энтропия» в 1865 году ввел немецкий физик Рудольф Клаузиус. Тогда он имел узкое значение и использовался в качестве одной из величин для описания состояния термодинамических систем — то есть, физических систем, состоящих из большого количества частиц и способных обмениваться энергией и веществом с окружающей средой. Проблема заключалась в том, что до конца сформулировать, что именно характеризует энтропия, ученый не смог. К тому же, по предложенной им формуле можно было определить только изменение энтропии, а не ее абсолютное значение.

Упрощенно эту формулу можно записать как dS = dQ/T. Это означает, что разница в энтропии двух состояний термодинамической системы (dS) равна отношению количества тепла, затраченного на то, чтобы изменить первоначальное состояние (dQ), к температуре, при которой проходит изменение состояния (T). Например, чтобы растопить лед, нам требуется отдать ему некоторое количество тепла. Чтобы узнать, как изменилась энтропия в процессе таяния, нам нужно будет поделить это количество тепла (оно будет зависеть от массы льда) на температуру плавления (0 градусов по Цельсию = 273, 15 градусов по Кельвину. Отсчет идет от абсолютного нуля по Кельвину ( — 273° С ), поскольку при этой температуре энтропия любого вещества равна нулю). Так как обе величины положительны, при подсчете мы увидим, что энтропии стало больше. А если провести обратную операцию — заморозить воду (то есть, забрать у нее тепло), величина dQ будет отрицательной, а значит, и энтропии станет меньше.

Примерно в одно время с этой формулой появилась и формулировка второго закона термодинамики: «Энтропия изолированной системы не может уменьшаться». Выглядит похоже на популярную фразу, упомянутую в начале текста, но с двумя важными отличиями. Во-первых, вместо абстрактного «мира» используется понятие «изолированная система». Изолированной считается та система, которая не обменивается с окружающей средой ни веществом, ни энергией. Во-вторых, категорическое «увеличение» меняется на осторожное «не убывает» (для обратимых процессов в изолированной системе энтропия сохраняется неизменной, а для необратимых — возрастает).

За этими скучноватыми нюансами скрывается главное: второй закон термодинамики нельзя без оглядки применять ко всем явлениям и процессам нашего мира. Хороший тому пример привел сам Клаузиус: он считал, что энтропия Вселенной постоянно растет, а потому когда-нибудь неизбежно достигнет своего максимума — «тепловой смерти». Этакой физической нирваны, в которой не протекают уже никакие процессы. Клаузиус придерживался этой пессимистической гипотезы до самой смерти в 1888 году — на тот момент научные данные не позволяли ее опровергнуть. Но в 1920-х гг. американский астроном Эдвин Хаббл доказал, что Вселенная расширяется, а значит, ее

сложно назвать изолированной термодинамической системой. Поэтому современные физики к мрачным прогнозам Клаузиуса относятся вполне спокойно.

Энтропия как мера хаоса

Поскольку Клаузиус так и не смог сформулировать физический смысл энтропии, она оставалась абстрактным понятием до 1872 года — пока австрийский физик Людвиг Больцман не вывел новую формулу, позволяющий рассчитывать ее абсолютное значение. Она выглядит как S = k * ln W (где, S — энтропия, k — константа Больцмана, имеющая неизменное значение, W — статистический вес состояния). Благодаря этой формуле энтропия стала пониматься как мера упорядоченности системы.

Как это получилось? Статистический вес состояния — это число способов, которыми можно его реализовать. Представьте рабочий стол своего компьютера. Сколькими способами на нем можно навести относительный порядок? А полный беспорядок? Получается, что статистический вес «хаотичных» состояний гораздо больше, а, значит больше и их энтропия. Посмотреть подробный пример и рассчитать энтропию собственного рабочего стола можно здесь.

В этом контексте новый смысл приобретает второй закон термодинамики: теперь процессы не могут самопроизвольно протекать в сторону увеличения порядка. Но и тут не стоит забывать про ограничения закона.

Иначе человечество уже давно было бы в рабстве у одноразовой посуды. Ведь каждый раз, когда мы моем тарелку или кружку, нам на помощь приходит простейшая самоорганизация. В составе всех моющих средств есть поверхно-активные вещества (ПАВ). Их молекулы составлены из двух частей: первая по своей природе стремится к контакту с водой, а другая его избегает.

При попадании в воду молекулы «Фэйри» самопроизвольно собираются в «шарики», которые обволакивают частички жира или грязи (внешняя поверхность шарика это те самые склонные к контакту с водой части ПАВ, а внутренняя, наросшая вокруг ядра из частички грязи — это части, которые контакта с водой избегают). Казалось бы, этот простой пример противоречит второму закону термодинамики. Бульон из разнообразных молекул самопроизвольно перешел в некое более упорядоченное состояние с меньшей энтропией. Разгадка снова проста: систему «Вода-грязная посуда после вечеринки», в которую посторонняя рука капнула моющего средства, сложно считать изолированной.

Черные дыры и живые существа

Со времен появления формулы Больцмана термин «энтропия» проник практически во

все области науки и оброс новыми парадоксами. Возьмем, к примеру астрофизику и пару «черная дыра — падающее в нее тело». Ее вполне можно считать изолированной системой, а значит, ее энтропия такой системы должна сохраняться. Но она бесследно исчезает в черной дыре — ведь оттуда не вырваться ни материи, ни излучению. Что же происходит с ней внутри черной дыры?

Некоторые специалисты теории струн утверждают, что эта энтропия превращается в энтропию черной дыры, которая представляет собой единую структуру, связанную из многих квантовых струн (это гипотетические физические объекты, крошечные многомерные структуры, колебания которых порождают все элементарные частицы, поля и прочую привычную физику). Впрочем, другие ученые предлагают менее экстравагантный ответ: пропавшая информация, все-таки возвращается в мир вместе с излучением, исходящим от черных дыр.

Еще один парадокс, идущий вразрез со вторым началом термодинамики — это существование и функционирование живых существ. Ведь даже живая клетка со всеми ее биослоями мембран, молекулами ДНК и уникальными белками — это высокоупорядоченная структура, не говоря уже о целом организме. За счет чего существует система с такой низкой энтропией?

Точнее организм питается углеводами, белками и жирами. Высокоупорядоченными, часто длинными молекулами со сравнительно низкой энтропией. А взамен выделяет в окружающую среду уже гораздо более простые вещества с большей энтропией. Вот такое вечное противостояние с хаосом мира.

Все меняется, и некоторым из нас это не всегда нравится. Но согласно одной из точек зрения, энтропия Вселенной и природы в целом (то есть степень беспорядка или случайности в системе) может быть тем, что в первую очередь способствовало возникновению жизни.

реклама

Согласно этой точке зрения, когда группа атомов приводится в движение внешним источником энергии, например Солнцем, и окружена источником тепла, например атмосферой, она постепенно перестраивается таким образом, чтобы рассеивать все больше энергии. С этого момента, при определенных условиях, материя неумолимо приобретает свойства, ассоциирующиеся с жизнью.

Однако энтропию также связывают с тепловой смертью Вселенной. Вот все, что необходимо знать об энтропии в термодинамике и о том, как она влияет на Вселенную и, в конечном счете, на нас.

Что такое энтропия Вселенной?

Хотя в физике это не одно и то же, полезно вспомнить о теории хаоса и о том, как она связана с энтропией, и, в конечном счете, какое влияние энтропия может оказывать на Вселенную.

реклама

Согласно теории хаоса, в кажущейся случайности хаотических, сложных систем есть скрытые закономерности и взаимосвязи. Если знать начальные условия и выяснить эти базовые закономерности, то можно предсказать нарушения, которые произойдут в будущем. Другими словами, хаос не так беспорядочен и случаен, как может показаться.

В своей самой простой формулировке энтропия определяется как мера тепловой энергии в системе на единицу температуры, которая не может быть использована для совершения полезной работы. Поскольку работа получается в результате упорядоченного движения молекул, энтропия также является мерой молекулярного беспорядка, или случайности, в системе.

Не только физика, но и многие дисциплины нашли применение этой концепции, включая химию, биологию, изменение климата, социологию, экономику, теорию информации и даже бизнес.

Но давайте остановимся на физике, а точнее, на фундаментальных законах термодинамики.

Кто ввел понятие энтропии?

реклама

Несмотря на то, что понятие энтропии применяется в различных дисциплинах, оно берет свое начало в физике. Изучая сохранение механической энергии в своей работе » Основные принципы равновесия и движения» (1803), французский математик Лазар Карно предложил, что ускорения и удары движущихся частей в машине представляют собой «потери момента активности». Момент активности» Карно сопоставим с современным понятием работы в термодинамике. Таким образом, в любом естественном процессе существует неотъемлемая тенденция к рассеиванию полезной энергии.

Другие ученые исследовали эту «потерянную» энергию, и в последней половине 19 века они указали, что это не настоящее исчезновение, а преобразование. Это и есть концепция сохранения энергии, которая проложила путь к первому закону термодинамики. Такие ученые, как Джеймс Джоуль, Юлиус Майер, Герман Гельмгольц и Уильям Томпсон (также известный как лорд Кельвин), опубликовали работы, исследующие эту концепцию.

реклама

Но термин «энтропия» появился в работах немецкого физика Рудольфа Клаузиуса, который сегодня считается одним из авторов термодинамики.

В 1850-х годах он представил изложение Второго закона термодинамики применительно к тепловому насосу. Заявление Клаузиуса подчеркивало тот факт, что невозможно построить устройство, работающее по циклу и не производящее никакого другого эффекта, кроме передачи тепла от более холодного тела к более горячему.

В 1860-х годах он придумал слово «энтропия» от греческого слова, означающего превращение, или поворотный пункт, для обозначения необратимой потери тепла. Он описал ее как функцию состояния в термодинамическом цикле, в частности в цикле Карно, теоретическом цикле, предложенном сыном Лазаря Карно, Сади Карно.

В 1870-х годах австрийский физик и философ Людвиг Больцман переосмыслил и адаптировал определение энтропии к статистической механике. Ближе к тому, что подразумевает этот термин сейчас, он описывает энтропию как измерение всех возможных микро-состояний в системе, макроскопическое состояние которой было изучено. Как могут измениться все наблюдаемые свойства системы? Сколькими способами? Эти вопросы охватывают понятие беспорядка, которое лежит в основе одного из понятий энтропии.

Находится ли Вселенная в состоянии энтропии?

Еще в 19 веке Рудолф Клаузиус вывел, что энергия Вселенной постоянна, а ее энтропия имеет тенденцию к увеличению с течением времени.

По мнению космологов, затем эта точка «взорвалась», расширяясь и распространяясь со скоростью, превышающей скорость света, и породив все частицы, античастицы и излучения во Вселенной.

Конечно, для этого должно было произойти огромное количество процессов связанных с изменением энтропии. Однако если мы подумаем о непрерывном увеличении энтропии, которое происходило на протяжении всех этих лет, то сможем сделать вывод, что энтропия Вселенной сейчас должна быть намного больше. На самом деле, согласно расчетам, энтропия Вселенной сегодня примерно в квадриллион раз больше, чем во время Большого взрыва.

Почему энтропия Вселенной растет?

Черные дыры обладают огромной концентрацией массы, которая обеспечивает им исключительно сильное гравитационное поле. Поэтому они допускают множественность микросостояний. В связи с этим Стивен Хокинг предположил, что черные дыры выделяют тепловое излучение вблизи своих горизонтов событий. Это излучение Хокинга может привести к потере массы и окончательному испарению черных дыр.

Но помните, что черные дыры подчиняются второму закону термодинамики, который гласит, что энтропия всегда будет иметь тенденцию к увеличению. Поэтому они будут набирать все большую массу и сливаться с другими черными дырами, превращаясь в сверхмассивные чёрные дыры. А когда они в конце концов распадутся, излучение Хокинга, создаваемое распадающимися чёрными дырами, будет иметь такое же количество возможных состояний, как и сама ранее существовавшая черная дыра. Согласно этой точке зрения, ранняя Вселенная имела низкую энтропию из-за меньшего количества или гораздо меньших размеров черных дыр.

Существует ли предел энтропии во Вселенной?

Как бы мы ни говорили о тенденции к увеличению энтропии, законы термодинамики также подразумевают состояние максимальной энтропии.

В повседневной жизни мы можем наблюдать это, когда наш кофе остывает в чашке. Когда кофе достигает комнатной температуры, это означает, что он находится в тепловом равновесии с окружающей средой. В кипящей воде, используемой для приготовления кофе, было много возбужденных атомов, но они замедлились и в конце концов достигли максимальной энтропии для данной системы.

При постоянной, стабильной температуре во всем космосе больше не останется энергии для совершения работы, так как энтропия достигнет максимального уровня. Все эти предположения составляют теорию тепловой смерти Вселенной. Эта теория также известна под названием «Большой заморозки», поскольку в этом сценарии энтропия Вселенной будет постоянно возрастать, пока не достигнет максимального значения. В этот роковой момент все тепло в нашей Вселенной будет распределено абсолютно равномерно, не оставляя места для полезной энергии.

Может ли энтропия Вселенной уменьшиться?

Можно с уверенностью сказать, что энтропия во Вселенной в какой-то момент уменьшилась, потому что в ней существует определенный порядок. Гравитационные взаимодействия могут к примеру превращать туманности в звезды. Это своего рода порядок.

Энтропия может уменьшаться без нарушения второго закона термодинамики до тех пор, пока она увеличивается в других частях системы. В конце концов, второй закон термодинамики не говорит, что энтропия не может уменьшаться в определенных частях системы, а только то, что общая энтропия системы имеет естественную тенденцию к увеличению.

При этом общая энтропия Вселенной не уменьшается. Как было сказано выше, энтропия будет иметь тенденцию к увеличению, пока не достигнет своего максимального уровня и не приведет к тепловой смерти. Это стационарное состояние термодинамического равновесия, в котором энтропия не только максимальна, но и постоянна, и она будет оставаться такой, пока не произойдет приток энергии, который оживит систему.

Тогда цикл может повториться. С новой, дополнительной энергией, совершающей работу, останется часть энергии, не способной совершить работу, которая превратится в тепло. Это снова увеличит энтропию системы. Но откуда возьмется эта энергия? Что заставит оставшиеся лептоны и фотоны, если таковые имеются, взаимодействовать?

Введение в понятие энтропии и ее многоликость

Как может показаться, анализ сигналов и данных — тема достаточно хорошо изученная и уже сотни раз проговоренная. Но есть в ней и некоторые провалы. В последние годы словом «энтропия» бросаются все кому не лень, толком и не понимая, о чем говорят. Хаос — да, беспорядок — да, в термодинамике используется — вроде тоже да, применительно к сигналам — и тут да. Хочется хотя бы немного прояснить этот момент и дать направление тем, кто захочет узнать чуть больше об энтропии. Поговорим об энтропийном анализе данных.

В русскоязычных источниках очень мало литературы на этот счет. А цельное представление вообще получить практически нереально. Благо, моим научным руководителем оказался как раз знаток энтропийного анализа и автор свеженькой монографии [1], где все расписано «от и до». Счастью предела не было, и я решила попробовать донести мысли на этот счет до более широкой аудитории, так что пару выдержек возьму из монографии и дополню своими исследованиями. Может, кому и пригодится.

Итак, начнем с начала. Шенноном в 1963 г. было предложено понятие меры усредненной информативности испытания (непредсказуемости его исходов), которая учитывает вероятность отдельных исходов (до него был еще Хартли, но это опустим). Если энтропию измерять в битах, и взять основание 2, то получим формулу для энтропии Шеннона

То есть в этом случае энтропия напрямую связана с «неожиданностью» возникновения события. А отсюда вытекает и его информативность — чем событие более предсказуемо, тем оно менее информативно. Значит и его энтропия будет ниже. Хотя открытым остается вопрос о соотношениях между свойствами информации, свойствами энтропии и свойствами различных ее оценок. Как раз с оценками мы и имеем дело в большинстве случаев. Все, что поддается исследованию — это информативность различных индексов энтропии относительно контролируемых изменений свойств процессов, т.е. по существу, их полезность для решения конкретных прикладных задач.

Энтропия сигнала, описываемого некоторым образом (т.е. детерминированного) стремится к нулю. Для случайных процессов энтропия возрастает тем больше, чем выше уровень «непредсказуемости». Возможно, именно из такой связки трактовок энтропии вероятность->непредсказуемость->информативность и вытекает понятие «хаотичности», хотя оно достаточно неконкретно и расплывчато (что не мешает его популярности). Встречается еще отождествление энтропии и сложности процесса. Но это снова не одно и то же.

Для того, чтобы немного обрисовать области применения энтропии к анализу данных, рассмотрим небольшую прикладную задачку из монографии [1] (которой нет в цифровом виде, и скорей всего не будет).

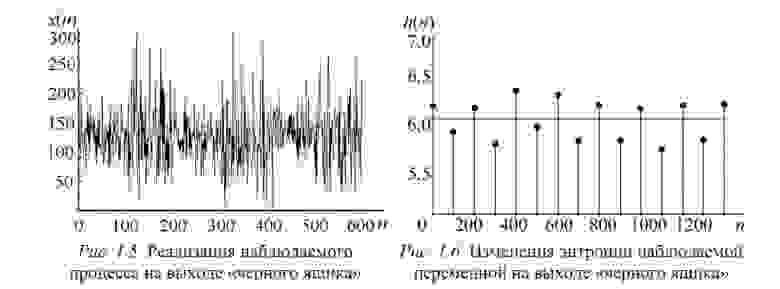

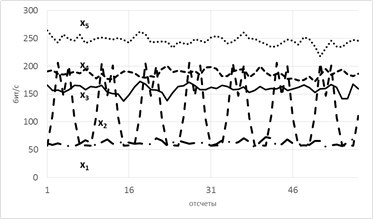

Пусть есть система, которая каждые 100 тактов переключается между несколькими состояниями и порождает сигнал x (рисунок 1.5), характеристики которого изменяются при переходе. Но какие — нам не известно.

Разбив x на реализации по 100 отсчетов можно построить эмпирическую плотность распределения и по ней вычислить значение энтропии Шеннона. Получим значения, «разнесенные» по уровням (рисунок 1.6).

Как можно видеть, переходы между состояниями явно наблюдаются. Но что делать в случае, если время переходов нам не известно? Как оказалось, вычисление скользящим окном может помочь и энтропия так же «разносится» на уровни.В реальном исследовании мы использовали такой эффект для анализа ЭЭГ сигнала (разноцветные картинки про него будут дальше).

Теперь еще про одно занятное свойство энтропии — она позволяет оценить степень связности нескольких процессов. При наличии у них одинаковых источников мы говорим, что процессы связаны (например, если землетрясение фиксируют в разных точках Земли, то основная составляющая сигнала на датчиках общая). В таких случаях обычно применяют корреляционный анализ, однако он хорошо работает только для выявления линейных связей. В случае же нелинейных (порожденных временными задержками, например) предлагаем пользоваться энтропией.

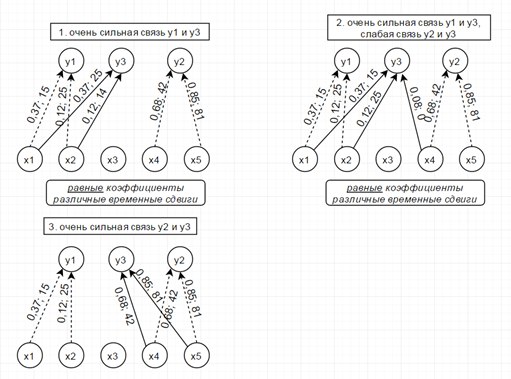

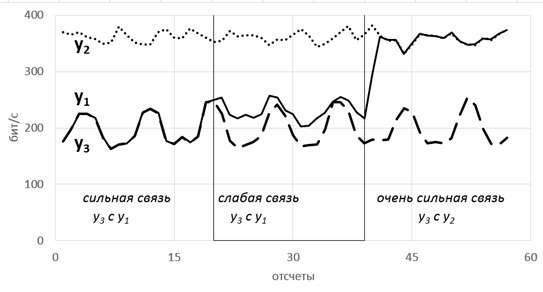

Рассмотрим модель из 5ти скрытых переменных(их энтропия показана на рисунке ниже слева) и 3х наблюдаемых, которые генерируются как линейная сумма скрытых, взятых с временными сдвигами по схеме, показанной ниже справа. Числа-это коэффициенты и временные сдвиги (в отсчетах).

Так вот, фишка в том, что энтропия связных процессов сближается при усилении их связи. Черт побери, как это красиво-то!

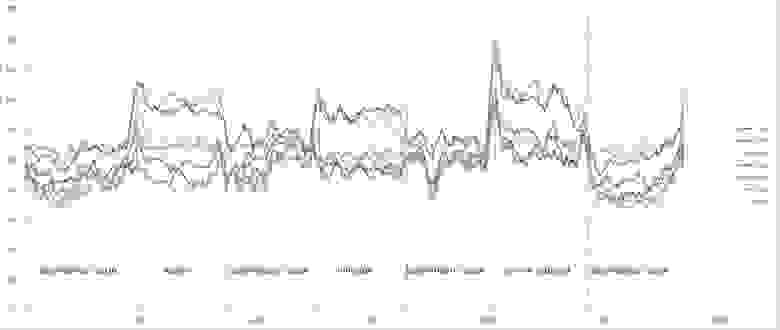

Такие радости позволяют вытащить практически из любых самых странных и хаотичных сигналов (особенно полезно в экономике и аналитике) дополнительные сведения. Мы их вытаскивали из электроэнцефалограммы, считая модную нынче Sample Entropy и вот какие картинки получили.

Можно видеть, что скачки энтропии соответствуют смене этапов эксперимента. На эту тему есть пара статей и уже защищена магистерская, так что если кому будут интересны подробности — с радостью поделюсь. А так по миру по энтропии ЭЭГ ищут уже давно разные вещи — стадии наркоза, сна, болезни Альцгеймера и Паркинсона, эффективность лечения от эпилепсии считают и тд. Но повторюсь-зачастую расчеты ведутся без учета поправочных коэффициентов и это грустно, так как воспроизводимость исследований под большим вопросом (что критично для науки, так то).

Резюмируя, остановлюсь на универсальности энтропийного аппарата и его действительной эффективности, если подходить ко всему с учетом подводных камней. Надеюсь, что после прочтения у вас зародится зерно уважения к великой и могучей силе Энтропии.

Глава 7. 2 Закон энтропии

В восьмом принципе мы рассмотрим механизм уничтожения систем, неспособных эволюционировать. Этот механизм основан на возрастании энтропии вокруг развивающихся систем. Для того чтобы разобраться с действием этого механизма, необходимо отметить, что рассматривать его следует только в совместном взаимодействии системы и надсистемы, в терминах “внутренняя среда и окружающая среда”. Понятие внутренней среды системы вряд ли нуждается в какой-то конкретизации. А вот понятию окружающей среды нужно дать следующее определение. Под окружающей средой будем понимать совокупность всех взаимодействующих систем, входящих в надсистему. Поскольку система является частью будущей надсистемы, и занимает пространство, принадлежащее ей, то окружающая среда является внутренней средой самой надсистемы. Поэтому то, что происходит вокруг системы, совсем не безразлично для надсистемы, т.к. имеет непосредственное к ней отношение.

Интеграция системы адекватна понятию самоорганизации. Объединение системы со своим противоположным свойством переводит ее из неравновесного состояния в равновесное или из непроявленного состояния в проявленное.

Главной особенностью, которая отличает полученные холономные системы, является низкая энтропия внутренней среды. Понятие энтропии вводится только на эволюционном пути развития систем. По определению эволюционных процессов интеграция противоположностей в исходное целое сопровождается упорядочиванием внутренней структуры.

Мы уже установили, что для обеспечения энергетической стабильности в конструктивных процессах им сопутствуют некоторые дезорганизационные процессы. Поэтому проявленная необходимость обеспечения организации системы некой дезорганизацией и обусловлена в восьмом принципе. В принципе, тезис о том, что любое созидание оплачивается разрушением, отнюдь не нов. Но он станет более понятным, если сформулировать его в следующем виде: организация внутренней структуры системы сопровождается дезорганизацией внутренней структуры надсистемы, т.е. разрушением окружающей среды. Этот тезис подразумевает, что созидание первично и является причиной разрушения окружающей среды. Таким образом, причиной повышения энтропии окружающей среды является необратимость эволюционных процессов самоорганизации, которые сопровождаются понижением энтропии внутренней среды системы.

О том, что энтропия в природе все время возрастает, было установлено еще в 19 веке в виде знаменитого второго начала термодинамики. Чаще всего второе начало термодинамики звучит так: всякое изменение состояния системы самопроизвольно может происходить лишь в сторону увеличения энтропии. Открытие второго начала термодинамики привнесло в физическую науку представление об эволюции как о движении от абсолютной организованности к полному хаосу или полному рассеянию энергии во Вселенной.

Однажды в одной очень умной книге я прочитала, что американские студенты-физики, чтобы лучше помнить законы термодинамики, заучивают следующую фразу: «Если первый закон утверждает, что вы не можете выиграть, то второй закон говорит, что у вас даже нет шанса остаться при своих».

Но ведь мы на Земле и в космосе повсеместно наблюдаем обратную тенденцию, в биологических и социальных системах наблюдается именно преобразование хаоса в упорядоченные структуры.

Почему современная физика указывает только на фундаментальные законы, объясняющие причины деградационных или дезорганизационных процессов? Почему до сих пор не найден сравнимый по фундаментальности контрфактор, который позволил бы последовательно объяснить конструктивные феномены? Парадокс между биологическим эволюционизмом и термодинамической необратимостью остается до сих пор нерешенным, хотя ушли уже в историю попытки опровержения второго начала на чисто физической основе. Но все же большие трудности, которые возникают в области термодинамики и, особенно, в наиболее важных случаях открытых систем, включающих живое вещество, служит поводом к ограничению второго начала.

Причем фактические противоречия между реальными процессами самоорганизации систем и законом возрастания энтропии во внешней среде отсутствуют. Не обнаруживается нарушений термодинамических законов и в связи с активностью живых организмов, поскольку энтропия отходов всегда превышает энтропию поступающих веществ. Это свидетельствует в пользу того, что конструктивные феномены, определяющие внутреннюю самоорганизацию систем, опосредуются процессами рассеяния энергии в окружающей среде. Объяснить возникший парадокс между восходящими тенденциями эволюционного развития в биологии, обществоведении и нисходящим направлением эволюции, обусловленным вторым началом термодинамики, не возможно вне единства системы и надсистемы. Даже в самых простых формулировках, дающих определение понятию необратимых процессов, можно увидеть явное указание на этот факт: “необратимыми называются такие процессы, которые могут самопроизвольно протекать только в одном направлении; в обратном направлении они могут протекать только как одно из звеньев более сложного процесса”. Этот более сложный процесс, как правило, и связан с функциональными действиями надсистемы.

Таким образом, законы количественного изменения энтропии нужно рассматривать только на уровне взаимодействий системы и надсистемы. Если до сих пор наши основные принципы описывали иерархичность взаимоотношений, при которых только изменения в надсистеме вызывали соответствующие изменения в системе, то теперь появляется обратная связь, и изменения в системе также вызывают ответные реакции в надсистеме. Теперь любые процессы, происходящие в системе, будут иметь определенный отклик в надсистеме, что в основном объясняется нелокальностью интегральной структуры и целевой детерминацией внутренних процессов системы. Как видим, в этом случае еще лишний раз подтверждается, что сама интегральная структура мироздания играет в процессах эволюции главенствующую роль. И никакими другими факторами вы не сможете объяснить парадокс между восходящими тенденциями эволюционного развития в биологии, обществоведении и нисходящим направлением эволюции, обусловленным вторым началом термодинамики.

В этом случае второе начало можно рассматривать, как частный случай более общего закона, который гласит: процессы понижения энтропии внутренней среды и повышения энтропии окружающей среды, которые сопровождают самоорганизацию системы, взаимно дополняют, определяют и обусловливают друг друга. Этот закон в дальнейшем будем называть законом сохранения энтропии. Поскольку насколько уменьшится энтропия системы, настолько увеличится энтропия в надсистеме.

Другими словами закон энтропии можно сформулировать и так: понижение энтропии внутри системы при ее самоорганизации сопровождается повышением энтропии в окружающей среде. Обратное утверждение не верно, т.е. повышение энтропии в окружающей среде не ведет к понижению энтропии внутренней среды. В этом случае закон энтропии устанавливает прямую однозначную зависимость между причиной – самоорганизацией системы и следствием – изменением энтропии внутри и снаружи неравновесной системы. Вследствие необратимости эволюционных процессов из этого закона можно сделать еще один вывод: целенаправленное разрушение окружающей среды сопровождается разрушением внутренней структуры системы, вызвавшей это разрушение.

Механизм действия закона энтропии в данном случае сводится к следующему. Если система производит в окружающей среде какие-либо разрушительные действия, то со стороны надсистемы возникает ответная реакция, направленная на восстановление причиненного ущерба. Процесс восстановления, сопровождаемый теперь понижением энтропии в окружающей среде, должен быть оплачен принудительным повышением энтропии в системе, которая произвела эти разрушения. Поскольку здесь затронуты интересы надсистемы, предусматривающие сохранения ее целостности, то в самой системе через интегральную структуру включается механизм действия обратных связей в подсистеме, регулирующей функции контроля. Потому что именно здесь на этом уровне и происходит накопление той самой энтропии, которую произвела система. Причем как видно, количество ее будет удвоено за счет возвращения произведенной энтропии из внешней среды и за счет самого процесса возврата, который тоже самопроизвольно происходить не может, а только с повышение энтропии внутри системы. Управление включением подобного механизма обусловлено детерминизмом интегральной структуры и опосредствовано функцией целеполагания, которая в данном случае защищает интересы надсистемы.

Конструктивные феномены, определяющие внутреннюю самоорганизацию систем, описаны в 7 принципе. Каждая системная функция представляет собой антиэнтропийный фактор, который участвует в процессах самоорганизации систем.

Принято считать, что действие антиэнтропийных факторов заключается в том, чтобы только противостоять разрушающему влиянию окружающей среды. На самом деле структурообразующие функции, которые отвечают за внутреннюю организацию системы, являются основной причиной повышения энтропии в системе. А действие управляющих функций не только приспосабливает окружающую среду к собственным нуждам, но в основном направлено на уменьшение энтропии на своем контролирующем уровне. Поскольку большое количество накопленной энтропии здесь может привести систему к самоуничтожению. Такие процессы будут успешными только в том случае, если система постоянно способна уменьшать энтропию вокруг себя.

Таким образом, из закона энтропии можно сделать еще один вывод. Система будет уничтожена в любом случае, если она не способна к самоорганизации, к эволюционным преобразованиям с соблюдением основных ее критериев. Поэтому для системы есть единственный путь – эволюционный, это значит, что в этом мире невозможно выжить, если не двигаешься вверх, даже простая остановка в развитии может привести к уничтожению.

Рис.23. Усилитель отбора

Механизм действия такого способа достижения цели близок по описанию «усилителю отбора», предложенному У. Эшби еще в 50-х годах. Он назвал его усилителем мыслительных способностей. Схема показана на рисунке 23. Генератор шума поставляет «сырье» в первую ступень усилителя. Преобразователь шума 2 создает разные случайные варианты объектов отбора. В блоке 3 происходит отбор в соответствии с заложенными в устройство критериями отбора. Если результат отбора удовлетворяет критерию, срабатывает блок управления 4, открывая клапан 5 и пропуская отработанную информацию в преобразователь следующей ступени усилителя. Можно представить, что в первой ступени усилителя, куда поступают случайные буквы, происходит отбор отдельных случайно возникших слов или характерных слогов. Во второй ступени происходит отбор сочетаний слов, в третьей – отбор фраз и т.д. В процессе случайного поиска возникает как раз та информации, которая нужна системе для перевода ее в новое состояние. Этот процесс назван отбором информации из шума.

В эволюционном «усилителе отбора» роль «генератора шума», который поставляет «сырье» играет интегральная схема мироздания. Она устроена таким образом, что способна порождать бесконечно большое количество структурных форм в виде различных развивающихся систем. Роль усилителей первой, второй и т.д. ступеней играют системные функции седьмого принципа. Восьмой принцип в «усилителе отбора» не описан, но его принцип понять не сложно. В блоке 3 усилителя, в котором происходит отбор, только часть систем проходят в преобразователь следующей ступени. Большинство же систем остаются в блоке. Наступает момент, когда блок переполняется и требуется основательная его очистка. Вот тут и вступает в действие восьмой принцип, и все оставшиеся системы в блоке 3 уничтожаются.

Таким образом, первым условием 9 принципа является закон необходимого разнообразия, дающий возможность создания достаточно большого количества вариантов.

Второе условие 9 принципа – фактор самообучения систем. Основные эволюционные критерии для развивающихся систем не известны, но чтобы сократить время на поиск необходимой информации из шума, каждая ступень разбивается на ряд дополнительных уровней, на которых происходит закрепление полученных признаков. При этом каждое удачное случайно образованное сочетание поощряется, каждое неудачное наказывается.

Такой механизм можно обыграть на следующем примере. Стрелок стреляет по невидимой мишени, и где она находится ему не известно. Но каждый раз, когда попадает предельно близко к цели, он получает определенный положительный знак, но зато после этого, стреляя не в ту сторону, он получает отрицательные знаки. Поэтому третьим условием, хотя его можно назвать и вместо второго, это возможность пройти одну и туже ступень с нескольких попыток. Фактически давая возможность нашему стрелку сделать несколько выстрелов, мы тем самым значительно выигрываем во времени. В противном случае нам приходилось бы заменять каждый раз стрелка на нового, и его единственный случайный выстрел мог бы очень долгое время не давать никого результата.

49 ступеней развития планеты

Прогрессивная эволюция материи характеризуется тем, что в развитии планеты постепенно снизу вверх проявляются семь созидающих сил. Одну из этих сил, которая фактически сформировала окружающую физическую Вселенную в том виде, в каком мы ее знаем, мы уже рассмотрели. Эта сила, прообразом которой был исходный D-признак, завершив процесс холономной интеграции, полностью вошла всеми своими исходными компонентами в единую целостность, называемую Вселенной. Как было показано ранее, в этом процессе участвуют производные четвертого и более высоких порядков. Интеграция с субъектным свойством, определяемым как Природа, создало материальную Вселенную со всеми действующими в ней физическими законами, Солнечную систему, нашу планету, которая стала первым объектом, участвующим в дальнейшей эволюции. Можно считать, что Природа, как один из аспектов субъективной реальности, устанавливает созидающие силы, определяющие образование, развитие и длительное существование физической материи. Завершение интеграции на уровне производных четвертого порядка определило существование корпускулярной материи, которая продолжила дальнейший путь интеграции на уровне третьих производных.

Каждый из семи уровней творения, благодаря 8 и 9 принципу делятся еще на 7 подуровней, которые мы теперь будем называть ступенями. В результате этого, в процессе эволюции можно выделить 49 ступеней. Эволюционирующие системы, последовательно проходя все эти ступени, осваивают определенный набор функций, который присущ каждой из них. Поэтому, рассматривая ход эволюции Земли, мы будем последовательно разбирать процессы, происходящие на каждой из них.

Дальше мы рассмотрим подробно интеграцию с каждым из семи функциональных свойств, которые обусловили определенные происходящие события в ходе эволюции планеты.